在探索人工智能的奥秘时,一句名言常常激励着我们:“如果我无法创造某物,那么我就没有理解它。”这是物理学家理查德·费曼的智慧结晶,如今在神经网络的领域中,这句话更显得意味深长。近日,让我们一起走进一个生动的实例,看看如何从零开始,用最简单的方式理解并构建一个神经网络。

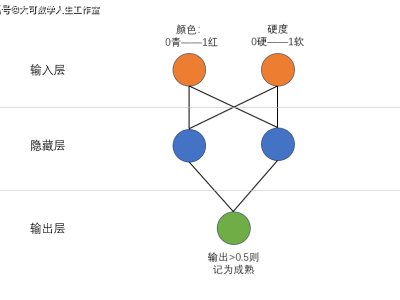

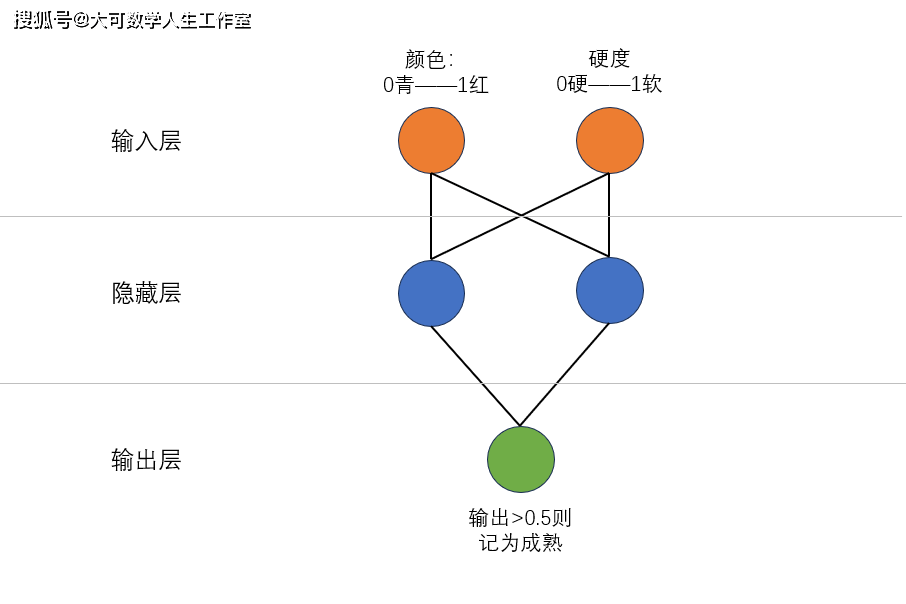

想象一下,农民伯伯想要通过颜色和硬度两个特征来判断一个苹果是否成熟。这个任务看似简单,但对于一个未经训练的神经网络来说,却是一片空白。为了解决这个问题,我们首先需要构建一个神经网络模型。这个模型包括输入层、隐藏层和输出层。输入层对应着颜色和硬度两个特征,因此有两个神经元;输出层对应着苹果的成熟情况,所以有一个神经元;而隐藏层,则是我们看不见的信息处理中心,可以根据需要设定神经元的数量,这里我们假设有两个。

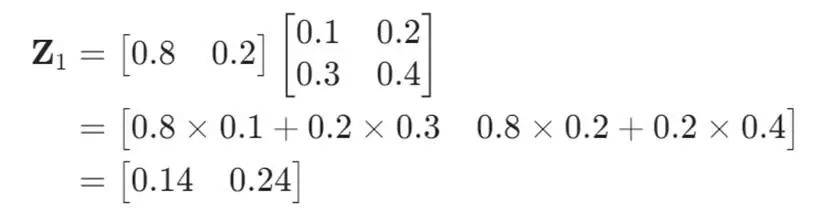

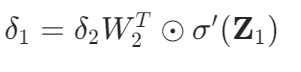

接下来,我们需要准备训练数据。在这个例子中,成熟的苹果被标记为1,不成熟的苹果被标记为0。而神经网络的输出值,如果大于0.5,则认为苹果是成熟的。为了训练这个神经网络,我们还需要初始化权重。权重决定了神经元之间传递数据的多少,是神经网络学习的关键。这里,我们随机初始化输入层到隐藏层的权重W1和隐藏层到输出层的权重W2。

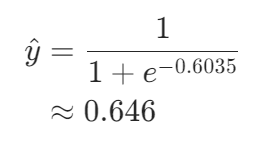

有了这些准备,我们就可以开始训练神经网络了。首先,我们通过一个苹果样本来计算神经网络的输出。这个样本的颜色值为0.8,硬度值为0.2,实际成熟度为1。通过矩阵乘法,我们可以计算出隐藏层的输入,然后通过Sigmoid函数得到隐藏层的输出。接着,将隐藏层的输出乘以隐藏层到输出层的权重,得到输出层的输入,再通过Sigmoid函数得到最终的输出值。

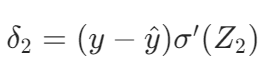

然而,这个输出值并不准确,与我们的实际值1存在差距。这时,我们就需要进行反向传播,根据这个差距来更新神经网络的权重。反向传播的过程涉及到梯度的计算,我们可以想象自己在一个山谷中,需要找到一条路径走到谷底。梯度的方向就是我们应该走的方向,而梯度的大小决定了我们走的步伐长度。通过计算输出层的误差项和隐藏层的误差项,我们可以更新权重,使神经网络的输出更加接近实际值。

经过这样的训练过程,我们得到了更新后的权重。这些权重使得神经网络在面对相同的输入时,能够输出更加准确的结果。当然,这只是一个简单的例子。在实际应用中,神经网络的训练过程要复杂得多,需要处理大量的数据和复杂的模型。但是,通过这个例子,我们可以初步理解神经网络的工作原理和训练过程。

如今,神经网络已经成为人工智能领域的重要工具。它们能够处理复杂的数据和任务,为我们的生活带来便利。然而,神经网络的构建和训练仍然是一个充满挑战的过程。通过不断的学习和实践,我们可以更好地理解和应用神经网络,为人工智能的发展贡献自己的力量。